Variables codépendantes : la prochaine frontière de l’IA

Le prompt est peut-être déjà une compétence intermédiaire.

Il a eu son moment de gloire. Il l’a encore, d’ailleurs. On peaufine ses consignes. On empile les contraintes. On demande à l’IA de respirer profondément avant de répondre. Charmant petit théâtre cognitif. Pourtant, la prochaine frontière ne se situe probablement pas là.

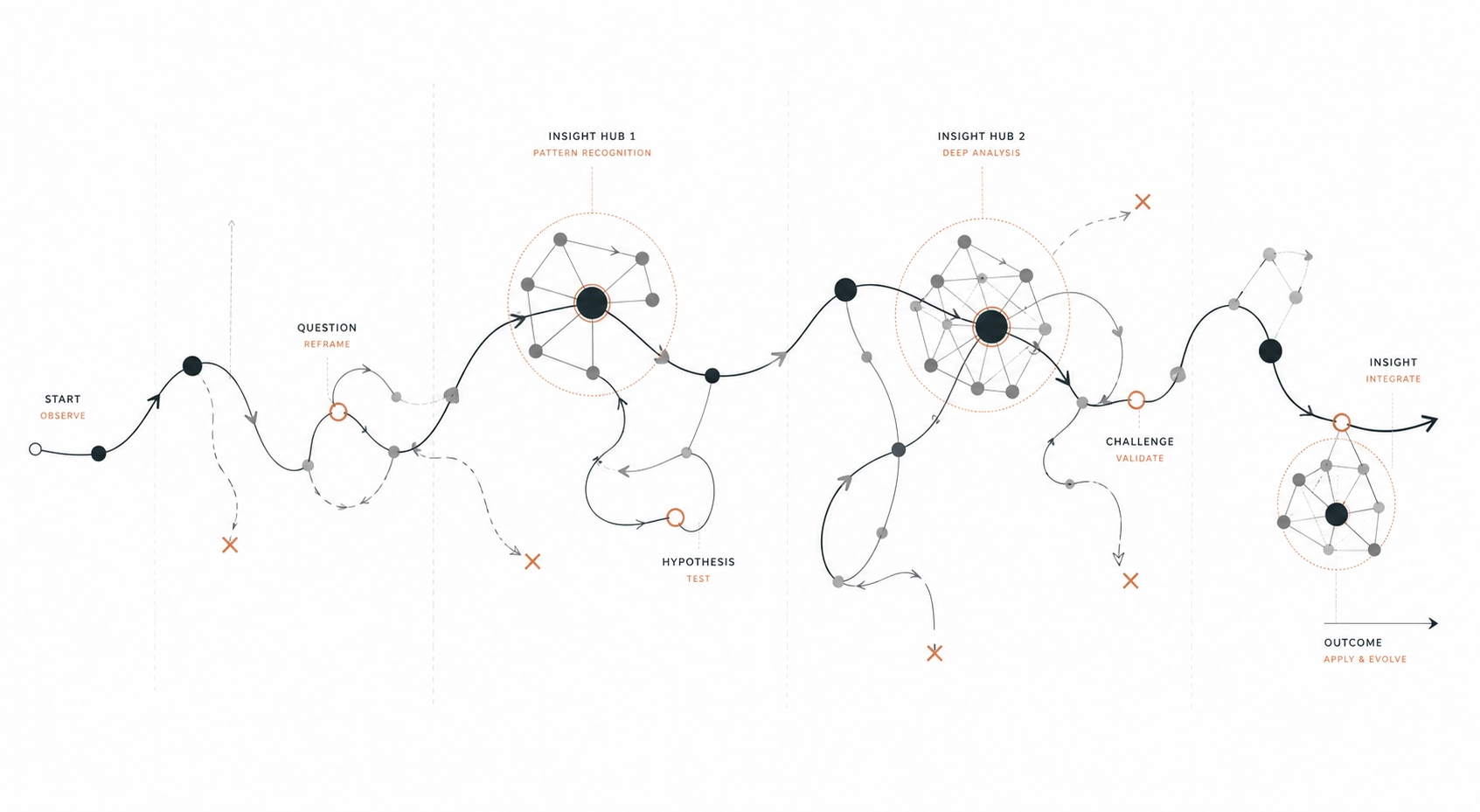

La vraie compétence, demain, consistera à comprendre les variables codépendantes. Ces idées, signaux faibles, expériences et concepts semblent parfois séparés. Pourtant, ils prennent toute leur valeur quand quelqu’un les relie. Et c’est précisément là que l’IA montre encore une forme de linéarité.

Elle répond bien. Elle développe bien. Elle synthétise bien. Mais elle ne voit pas toujours le passage secret entre une intuition philosophique, une décision d’investissement, un problème d’organisation et une expérience vécue en Chine.

Pour un modèle, ces éléments restent souvent des blocs distincts. Pour un cerveau humain entraîné, ils deviennent parfois les pièces d’un même système.

L’IA pense encore trop souvent en ligne droite

L’IA actuelle donne parfois l’impression d’une pensée profonde. Elle déroule. Elle classe. Elle organise. Elle nomme. Elle hiérarchise. Cependant, relier ne signifie pas seulement organiser.

Relier, c’est sentir qu’un détail périphérique peut devenir central. C’est comprendre qu’une remarque anodine en réunion peut éclairer une stratégie de marché. C’est voir qu’un comportement client, un biais culturel et une faille opérationnelle appartiennent peut-être au même problème.

Les modèles de raisonnement progressent, bien sûr. Pourtant, leurs limites apparaissent dès que la complexité augmente. Certains travaux récents sur les modèles de raisonnement montrent que leurs performances deviennent instables lorsque les problèmes exigent plusieurs niveaux d’abstraction. Ce constat ne signifie pas que l’IA est faible. Il signifie plutôt que son intelligence dépend encore fortement du cadre dans lequel on l’inscrit.

Les variables codépendantes : ce que l’IA ne relie pas encore seule

Une variable codépendante désigne un élément qui paraît autonome, mais dont la vraie signification dépend d’un autre élément.

Un signal faible n’a souvent aucun intérêt seul. Une phrase entendue dans une négociation peut sembler banale. Une lecture économique peut paraître théorique. Une intuition philosophique peut sembler perchée, surtout lorsqu’elle arrive entre deux tableaux Excel et un café tiède. Pourtant, ces éléments peuvent révéler une structure lorsqu’on les observe ensemble. C’est ici que se situe le capital décisionnel.

Un dirigeant ne gagne pas seulement parce qu’il possède plus d’informations. Il gagne parce qu’il comprend quelles informations doivent entrer en relation. L’IA peut accélérer cette mise en forme. Elle peut classer, résumer et comparer. Elle peut même faire émerger des pistes intéressantes. Mais elle ne décide pas toujours seule que deux mondes éloignés doivent se parler. Or, dans une vraie réflexion stratégique, cette décision change tout.

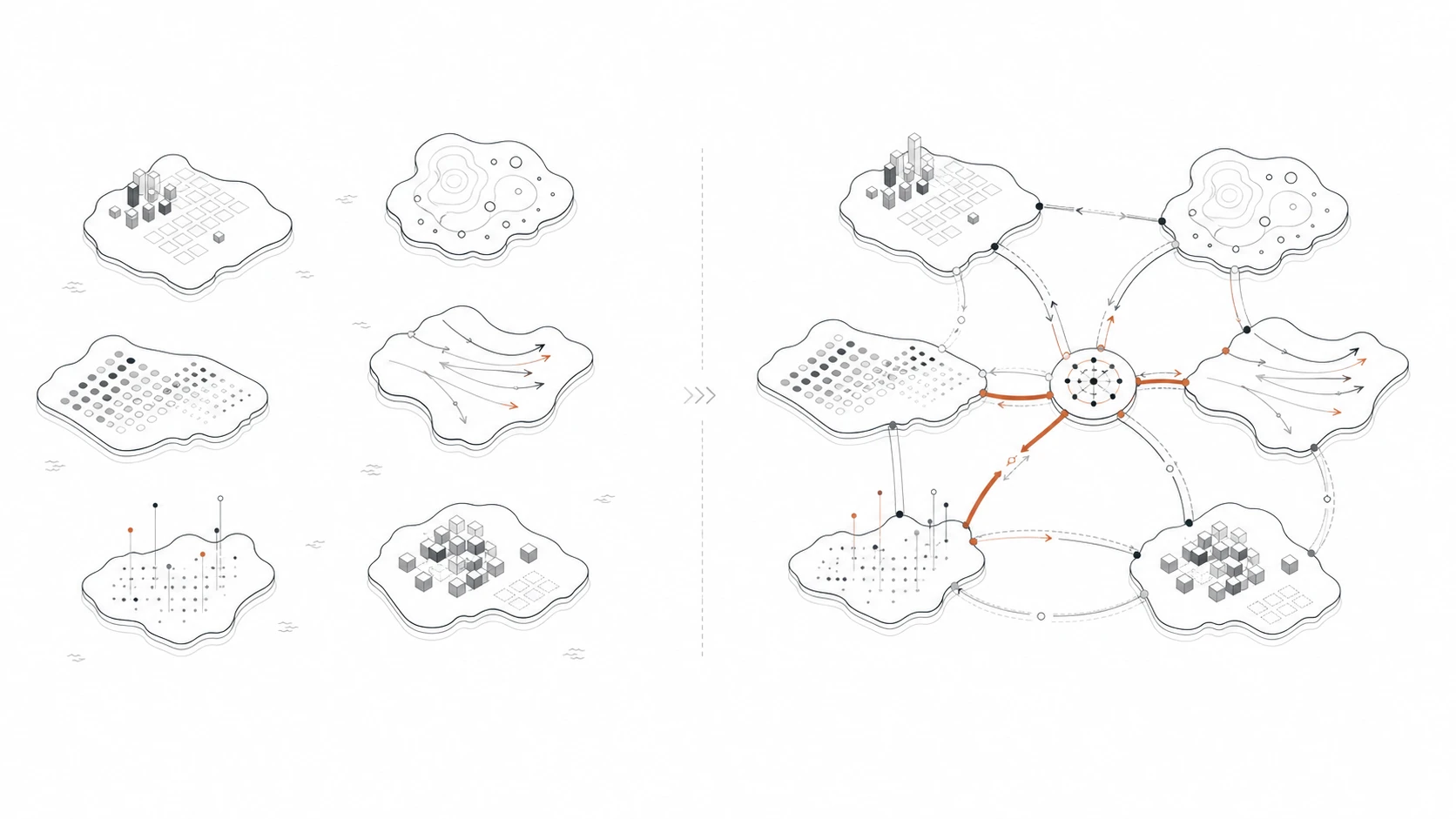

La personnalisation : quand l’IA commence à mieux vous connaître

La première piste de solution repose sur la personnalisation. Plus une IA vous connaît, plus elle peut relier vos idées, vos expériences, vos références, vos décisions passées et vos angles morts. C’est un point décisif.

Une IA générique répond à une question générique. Une IA nourrie par votre historique, vos documents, vos raisonnements et vos arbitrages commence à détecter des motifs récurrents.

Elle peut comprendre que votre manière de penser l’IA vient aussi de votre expérience interculturelle. Elle peut voir que votre rapport à la stratégie vient autant du terrain que de la technologie. C’est un début de vraie collaboration homme/machine.

Cependant, cette personnalisation exige une vraie discipline.

Il ne suffit pas d’accumuler des documents dans un espace de travail. Il faut organiser les données que l’on donne à la machine. Il faut structurer les contextes, nommer les décisions, conserver les raisonnements et clarifier les critères. Sinon, on ne personnalise pas l’intelligence. On personnalise le chaos.

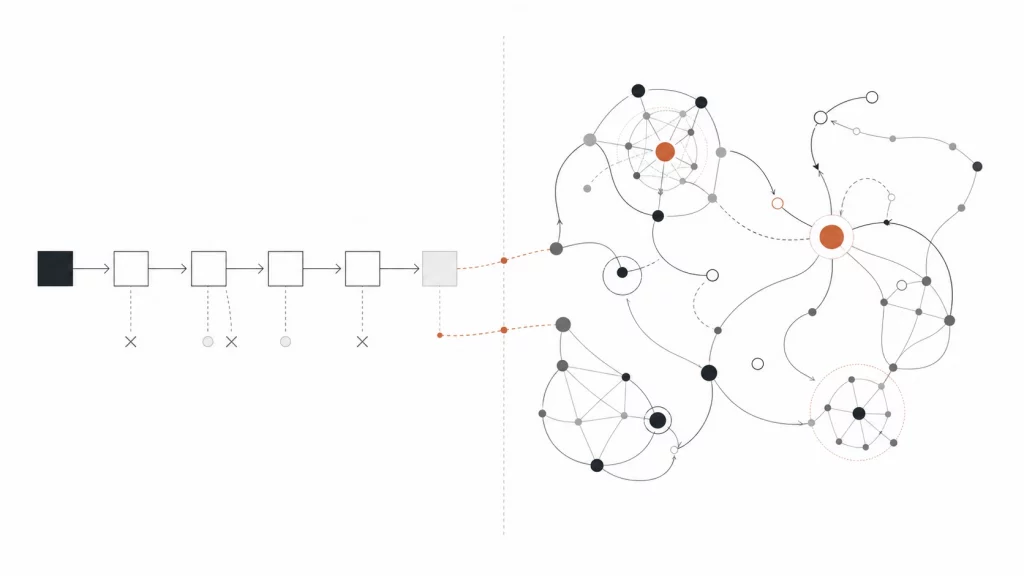

Fragmenter la pensée de l’IA pour mieux créer des ponts

La deuxième piste repose sur la fragmentation maîtrisée. Au lieu de demander à une seule IA de tout penser, une entreprise peut créer des îlots d’expertise. Un agent analyse la stratégie. Un autre suit la cognition. Un autre travaille le SEO. Un autre observe la concurrence. Un autre détecte les signaux faibles. Cette approche semble logique. Pourtant, elle contient un piège.

Le vrai sujet n’est pas l’existence des îlots. Le vrai sujet concerne la qualité des ponts entre eux. Sinon, on ne construit pas une intelligence distribuée. On fabrique une réunion interminable entre consultants numériques. Et franchement, nous avons déjà assez souffert comme ça. La valeur apparaît dans les points de passage.

Elle apparaît lorsqu’une expertise traduit ce qu’elle voit à une autre expertise. Elle apparaît lorsqu’un agent spécialisé ne reste pas enfermé dans son couloir, mais transmet une hypothèse, une tension ou une anomalie. C’est ici que les prompts systèmes deviennent essentiels.

Le prompt avancé comme architecture des connexions

Le prompt avancé ne doit plus seulement demander une réponse. Il doit orchestrer une manière de penser. Il doit dire à l’IA : ne te contente pas de répondre. Cherche les variables cachées. Relie les concepts éloignés. Identifie les dépendances faibles. Fais dialoguer les contradictions. Repère les vides.

Le prompt devient alors une architecture cognitive. Les agents IA doivent chercher les ponts, pas seulement livrer des paragraphes propres. Cette différence paraît subtile. En réalité, elle transforme complètement l’usage de l’outil. Un bon système ne demande pas seulement : « Résume ce document. » Il demande plutôt : « Quelles idées éloignées deviennent codépendantes si l’on change d’échelle ? »

Ce type de formulation change la nature de la réponse. Il oblige l’IA à ne plus seulement produire du contenu. Il l’oblige à chercher des relations.

Paramétrer les LLM : pourquoi les profils non techniques deviennent indispensables

Il existe aussi un travail immense à mener en amont des modèles. Le paramétrage des IA ne peut pas rester uniquement une affaire d’ingénieurs. Les ingénieurs restent indispensables, évidemment. Mais ils ne suffisent pas.

Il faut aussi des philosophes, des linguistes, des psychologues, des anthropologues, des stratèges et des profils capables de penser la nuance.

Pourquoi ?

Parce que le problème n’est pas seulement technique. Il est sémantique. Il est culturel. Il est presque organique. Une IA peut manipuler des milliards de paramètres. Pourtant, comprendre pourquoi deux idées éloignées doivent soudain se rejoindre demande une sensibilité aux contextes, aux valeurs, aux croyances et aux effets de bord.

Cette sensibilité ne remplace pas la technique. Elle l’oriente. Et lorsqu’elle l’oriente bien, elle permet aux modèles de mieux franchir les espaces vides entre les concepts.

La maîtrise des vides : ce que Perelman nous rappelle

Grigori Perelman a résolu la conjecture de Poincaré, l’un des grands problèmes mathématiques du XXe siècle. Son histoire fascine parce qu’elle ne parle pas seulement de calcul. Elle parle d’une capacité rare à voir des structures là où d’autres ne voient qu’un espace abstrait, presque inhabitable.

Ce qui m’intéresse ici n’est pas de transformer Perelman en mascotte LinkedIn. Le pauvre a déjà assez donné. Ce qui compte, c’est l’image. Penser vraiment, c’est parfois savoir habiter les vides.

C’est voir les espaces entre les formes. C’est comprendre que ce qui manque relie parfois mieux que ce qui est visible. Dans l’IA, la solution se trouve peut-être là. Elle se trouve dans la capacité à identifier les vides entre les concepts, puis à construire les ponts nécessaires.

Le vrai capital décisionnel sera relationnel

Les meilleurs utilisateurs de l’IA ne seront pas seulement ceux qui écrivent les meilleures consignes. Ils seront ceux qui savent cartographier les relations faibles entre des idées fortes.

Ils comprendront qu’une décision stratégique, une intuition humaine, une donnée client, une expérience interculturelle et une limite technique peuvent appartenir au même système. L’IA deviendra alors un vrai partenaire de décision.

L’IA continuera de progresser. Elle deviendra plus personnalisée, plus contextuelle et mieux orchestrée par des agents spécialisés. Cependant, pour l’instant, elle a encore besoin de nous pour lui montrer où regarder. Et surtout, où relier.

Si vous voulez évaluer la maturité réelle de votre usage IA, pas seulement vos outils ou vos prompts, un audit stratégique IA permet d’identifier vos points de passage, vos angles morts et vos opportunités de structuration.

Retrouvez d’autres analyses sur le blog de David Tabacznyj. Vous pouvez également poursuivre l’échange sur LinkedIn.